本文最后由 Demo Marco 更新于 2025-02-22. 如有资源已失效,请留言反馈,将会及时处理。 【推荐:不翻墙访问被墙网站方法 | 自用高速专线机场 | 高速CN2线路 | 高质量家宽住宅IP】

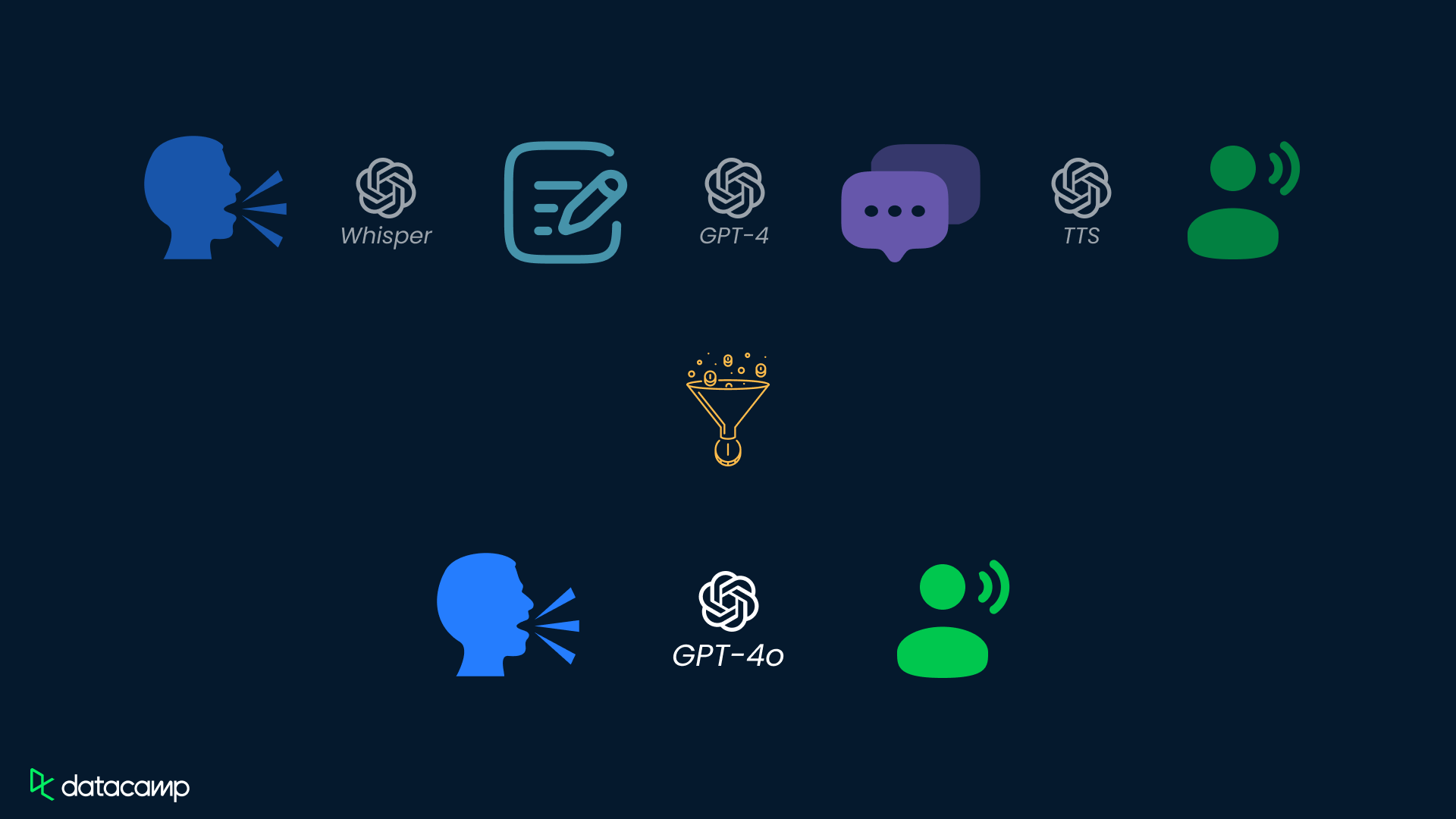

OpenAI 的 GPT-4o 将音频、视觉和文本功能集成到一个强大的语言模型中。

这一发展标志着人机交互朝着更加自然和直观的方向迈出了重要一步。

在本教程中,我将提供通过 OpenAI API 使用 GPT-4o 的分步指导。

尽管 OpenAI 最近发布了 O1 模型(其最强大的推理模型),但 GPT-4o 和 GPT-4o mini 仍然是需要快速响应、图像处理或函数调用的应用程序的最佳选择。

什么是 GPT-4o?

GPT-4o 是“omni”的缩写,代表了人工智能的重大进步。与仅处理文本的 GPT-4 不同,GPT-4o 是一个多模态模型,可以处理和生成文本、音频和视觉数据。

通过将音频和视觉数据与文本结合起来,GPT-4o 摆脱了传统纯文本模型的限制,创造出更自然、更直观的交互。

GPT-4o 的响应时间更快,比 GPT-4 Turbo 便宜 50%,并且在音频和视觉理解方面比现有模型更出色。

GPT-4o 用例

开发人员除了可以通过ChatGPT接口与 GPT-4o 交互之外,还可以通过OpenAI API与 GPT-4o 交互,从而将 GPT-4o 的功能集成到他们的应用程序和系统中。

GPT-4o API 利用其多模式功能开辟了广泛的潜在用例:

| 情态 | 使用案例 | 描述 |

| 文本 | 文本生成、文本摘要、数据分析和编码 | 内容创建、简洁摘要、代码解释和编码帮助。 |

| 声音的 | 音频转录、实时翻译、音频生成 | 将音频转换为文本,实时翻译,创建虚拟助手或语言学习。 |

| 想象 | 图像字幕、图像分析与逻辑、视障人士无障碍 | 描述图像,分析视觉信息,为视障人士提供无障碍服务。 |

| 多 | 多模式互动、角色扮演场景 | 无缝结合各种模式,创造沉浸式体验。 |

GPT-4o API:如何连接到 OpenAI 的 API

现在让我们探索如何通过 OpenAI API 使用 GPT-4o。

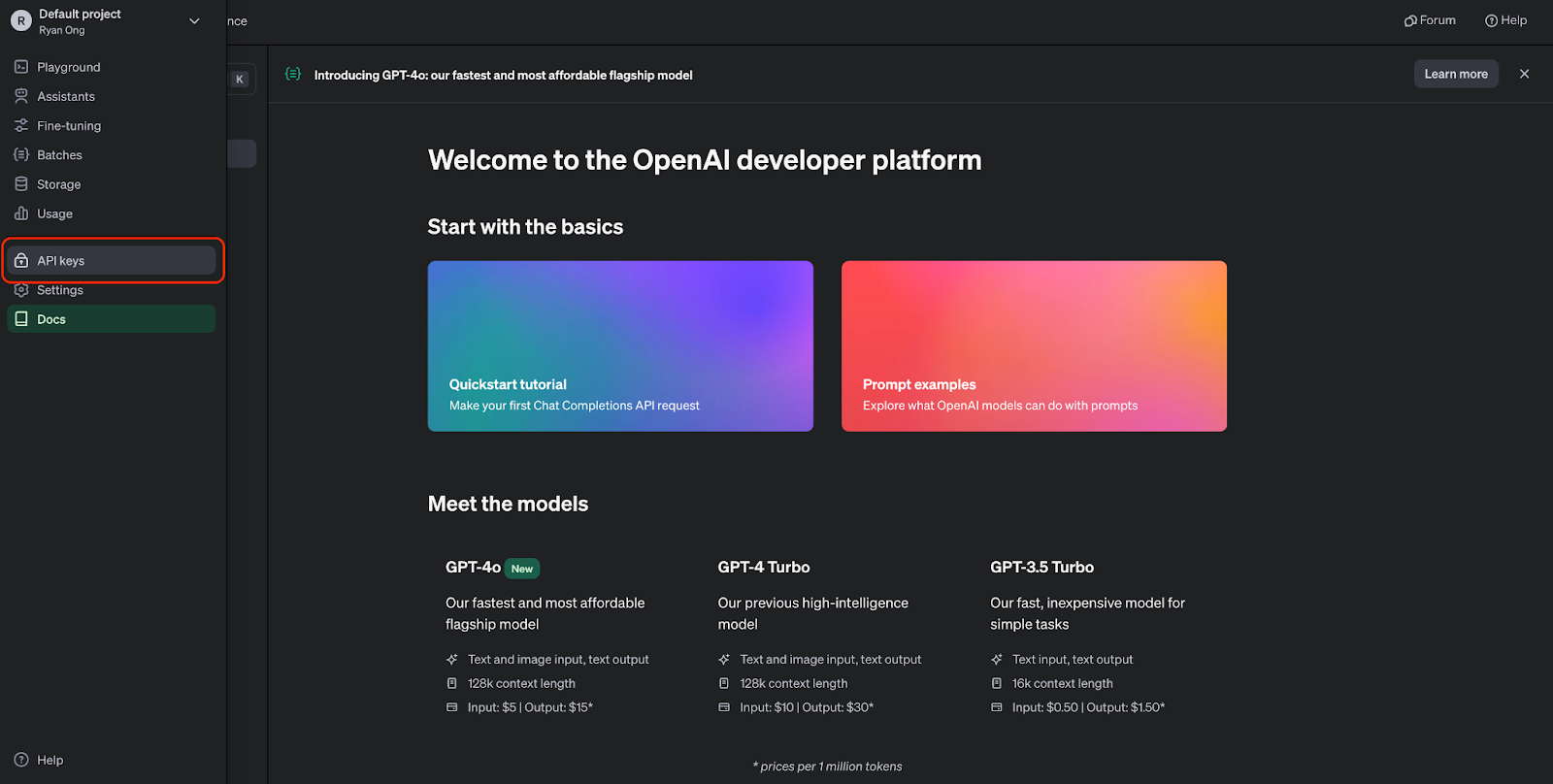

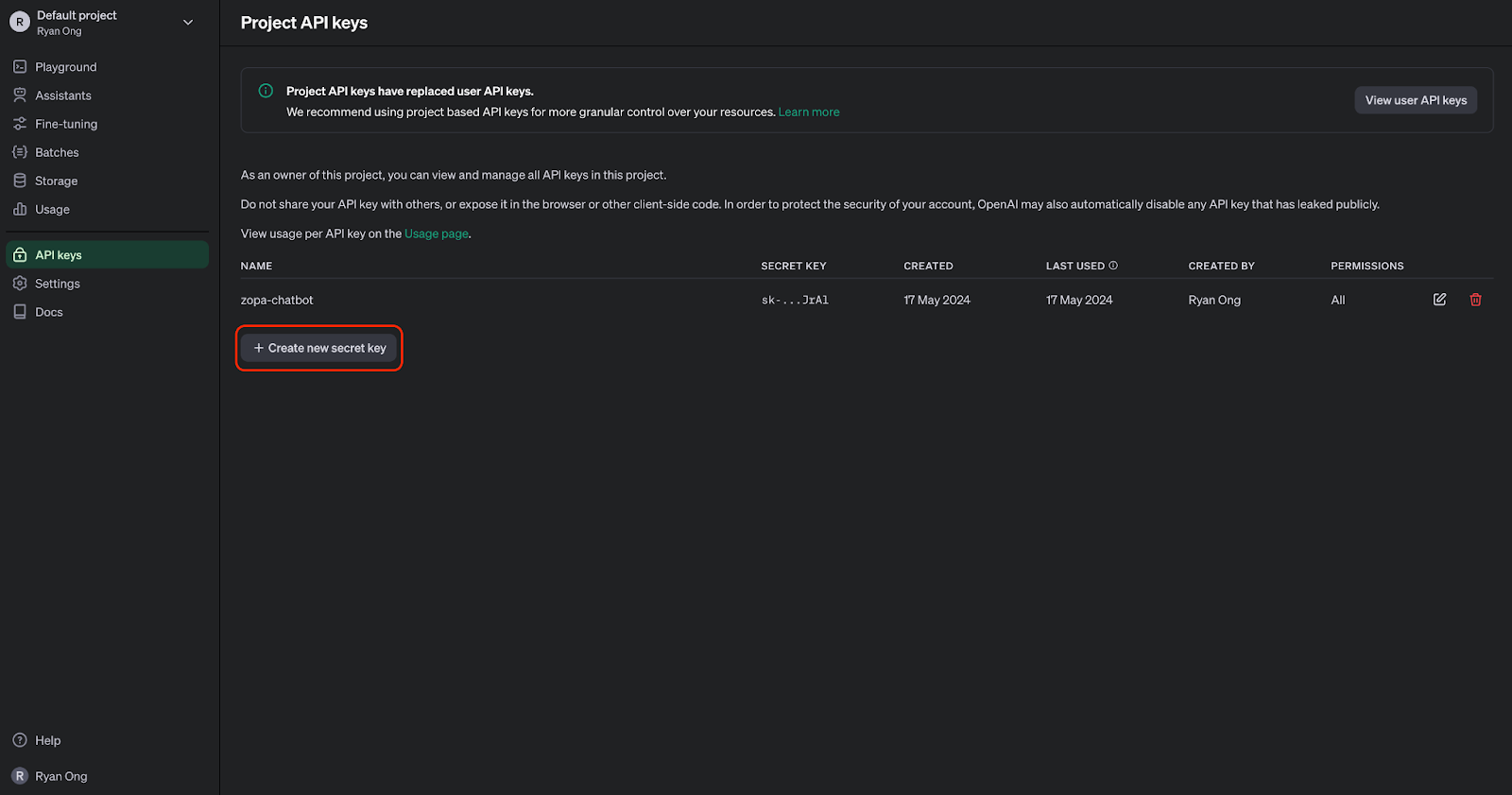

步骤 1:生成 API 密钥

在使用 GPT-4o API 之前,我们必须注册一个 OpenAI 账号,并获取一个 API 密钥。我们可以在OpenAI API 网站上创建一个账号。

一旦我们有了账户,我们就可以导航到 API 密钥页面:

现在我们可以生成 API 密钥了。我们需要妥善保管,因为我们无法再次查看它。但如果丢失了它或者需要用于其他项目,我们随时可以生成一个新的。

第 2 步:将 OpenAI API 导入 Python

要以编程方式与 GPT-4o API 交互,我们需要安装 OpenAI Python 库。我们可以通过运行以下命令来执行此操作:

安装后,我们可以将必要的模块导入到我们的 Python 脚本中:

from openai import OpenAI步骤 3:进行 API 调用

在我们发出 API 请求之前,我们需要使用 API 密钥进行身份验证:

## Set the API keyclient = OpenAI(api_key="your_api_key_here")用您的实际 API 密钥替换"your_api_key_here"。

完成客户端连接后,我们就可以开始使用 GPT-4o 生成文本了:

MODEL="gpt-4o"completion = client.chat.completions.create( model=MODEL, messages=[ {"role": "system", "content": "You are a helpful assistant that helps me with my math homework!"}, {"role": "user", "content": "Hello! Could you solve 20 x 5?"} ])print("Assistant: " + completion.choices[0].message.content)此代码片段将聊天完成 API 与 GPT-4o 模型结合使用,该模型接受与数学相关的问题作为输入并生成响应:

GPT-4o API:音频用例

音频转录和摘要已成为各种应用中必不可少的工具,从提高可访问性到提高生产力。借助 GPT-4o API,我们可以高效地处理转录和摘要音频内容等任务。

虽然 GPT-4o 有直接处理音频的潜力,但直接音频输入功能尚未通过 API 提供。目前,我们可以使用 GPT-4o API 的两步流程来转录然后总结音频内容。

步骤 1:将音频转录为文本

要使用 GPT-4o 转录音频文件,我们必须向 API 提供音频数据。以下是示例:

# Transcribe the audioaudio_path = "path/to/audio.mp3"transcription = client.audio.transcriptions.create( model="whisper-1", file=open(audio_path, "rb"),)替换"path/to/audio.mp3"为音频文件的实际路径。此示例使用模型whisper-1进行转录。

第 2 步:总结音频文本

response = client.chat.completions.create( model=MODEL, messages=[ {"role": "system", "content":"""You are generating a transcript summary. Create a summary of the provided transcription. Respond in Markdown."""}, {"role": "user", "content": [ {"type": "text", "text": f"The audio transcription is: {transcription.text}"} ], } ], temperature=0,)print(response.choices[0].message.content)GPT-4o API:视觉用例

从医疗保健到安全等各个领域,视觉数据分析都至关重要。借助 GPT-4o API,您可以无缝分析图像、参与有关视觉内容的对话并从图像中提取有价值的信息。

步骤 1:向 API 添加图像数据

要使用 GPT-4o 分析图像,我们必须首先将图像数据提供给 API。我们可以通过将本地图像编码为字符串base64或提供在线图像的 URL 来实现这一点:

import base64IMAGE_PATH = "image_path"# Open the image file and encode it as a base64 stringdef encode_image(image_path): with open(image_path, "rb") as image_file: return base64.b64encode(image_file.read()).decode("utf-8")base64_image = encode_image(IMAGE_PATH) "url": "<https://images.saymedia-content.com/.image/c_limit%2Ccs_srgb%2Cq_auto:eco%2Cw_538/MTczOTQ5NDQyMzQ3NTc0NTc5/compound-shapes-how-to-find-the-area-of-a-l-shape.webp>"第 2 步:分析图像数据

一旦我们处理了图像输入,我们就可以将图像数据传递给 API 进行分析。

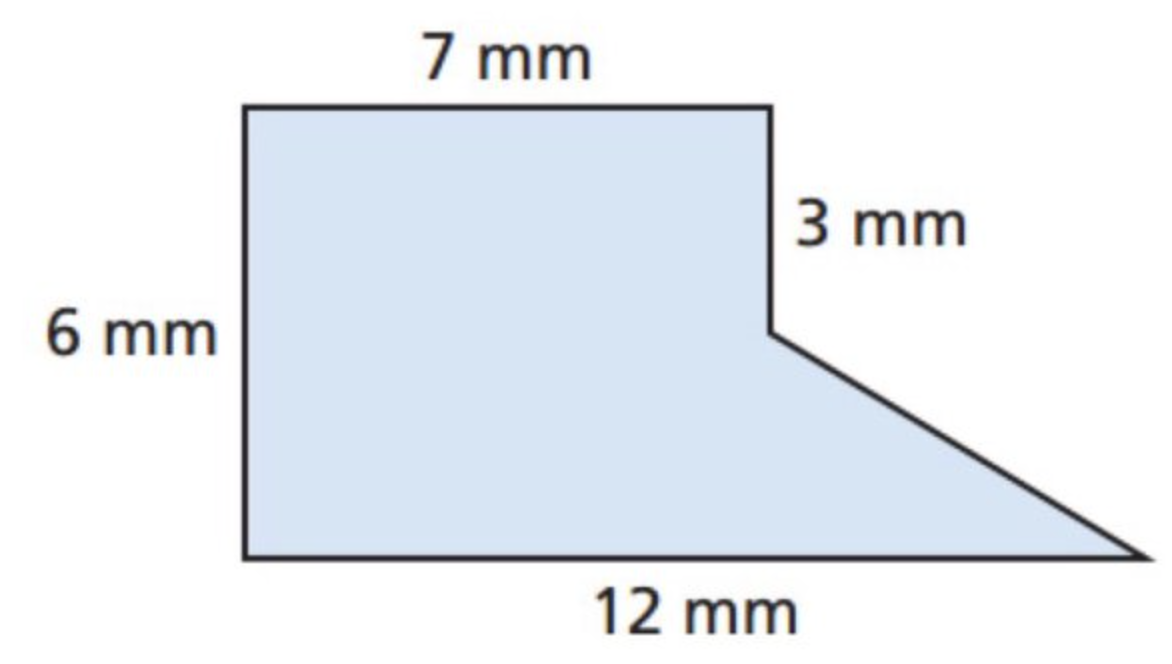

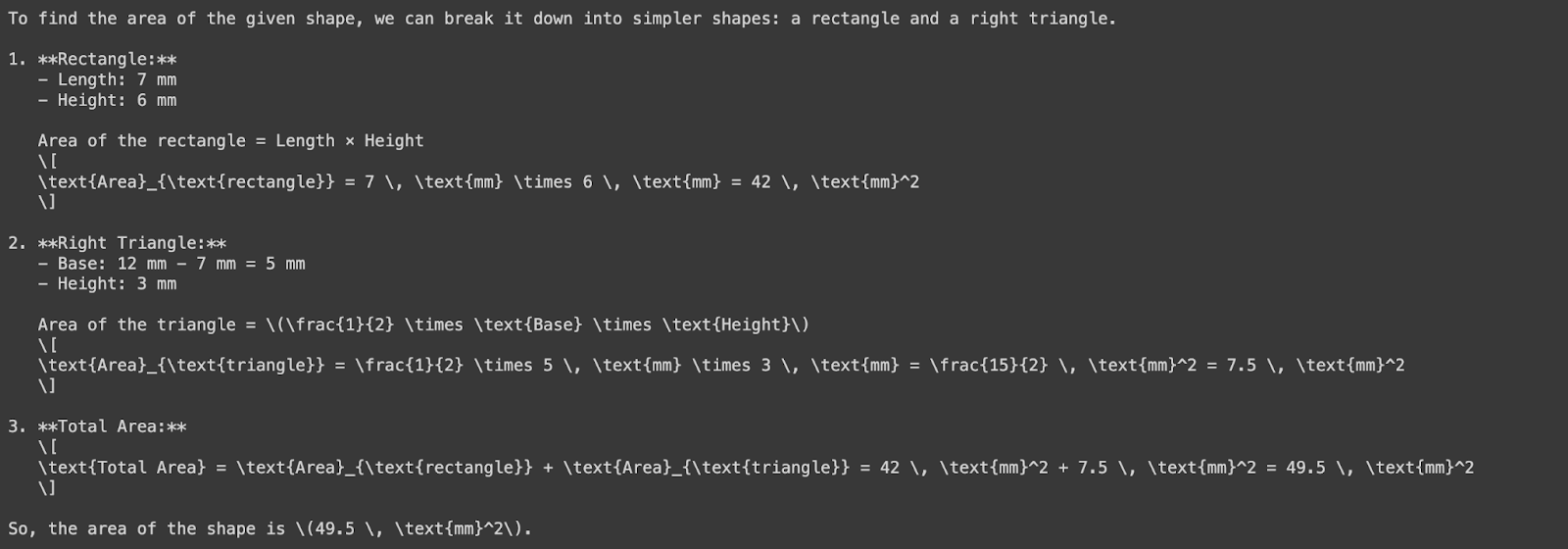

让我们尝试分析图像以确定形状的面积。让我们首先使用下面的图像:

现在,我们将要求 GPT-4o 询问此形状的面积——请注意,我们在下面使用了 base64 图像输入:

response = client.chat.completions.create( model=MODEL, messages=[ {"role": "system", "content": "You are a helpful assistant that responds in Markdown. Help me with my math homework!"}, {"role": "user", "content": [ {"type": "text", "text": "What's the area of the shape in this image?"}, {"type": "image_url", "image_url": { "url": f"data:image/png;base64,"} } ]} ], temperature=0.0,)print(response.choices[0].message.content)

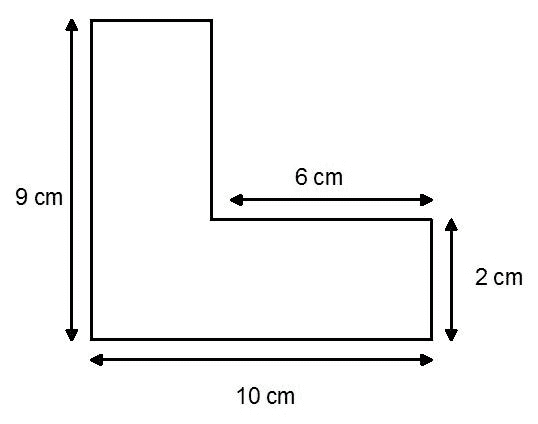

现在让我们考虑这个形状:

我们将图像 URL 传递给 GPT-4o 来查找形状的面积:

response = client.chat.completions.create( model=MODEL, messages=[ {"role": "system", "content": "You are a helpful assistant that responds in Markdown. Help me with my math homework!"}, {"role": "user", "content": [ {"type": "text", "text": "What's the area of the shape in the image?"}, {"type": "image_url", "image_url": { "url": "<https://images.saymedia-content.com/.image/c_limit%2Ccs_srgb%2Cq_auto:eco%2Cw_538/MTczOTQ5NDQyMzQ3NTc0NTc5/compound-shapes-how-to-find-the-area-of-a-l-shape.webp>"} } ]} ], temperature=0.0,)print(response.choices[0].message.content)

请注意,GPT-4o 错误地测量了垂直矩形的宽度——应该是 4 厘米,而不是 2 厘米。这种差异是由于测量标签与矩形的实际比例不一致造成的。无论如何,这再次凸显了人工监督和验证的重要性。

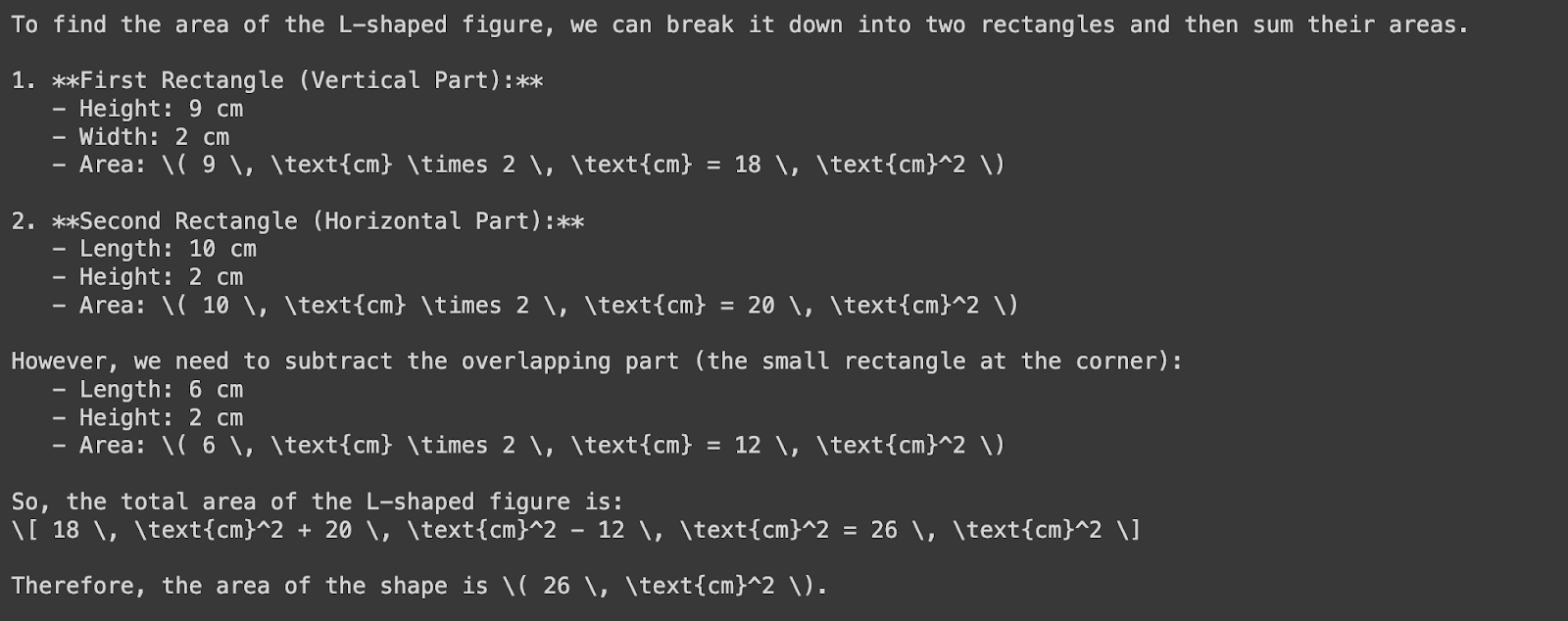

GPT-4o API 定价

OpenAI 为 GPT-4o API 引入了有竞争力的定价结构,使其比以前的模型更易于访问且更具成本效益。

以下是 Antropic 的 Claude 和 Google 的 Gemini 型号的定价摘要(定价以美元计):

如您所见,GPT-4o 的价格明显低于 GPT-4 Turbo 和 GPT-4。与 Claude Opus 和 Gemini 1.5 Pro 等其他最先进的语言模型相比,它的价格也极具竞争力。

GPT-4o API:关键考虑因素

使用 GPT-4o API 时,请务必记住一些关键注意事项,以确保最佳性能、成本效益以及与每个特定用例的一致性。以下是需要考虑的三个关键因素:

定价和成本管理

OpenAI API 遵循按使用付费模式,费用根据处理的令牌数量产生。

尽管 GPT-4o 比 GPT-4 Turbo 便宜,但相应地规划我们的使用对于估算和管理成本至关重要。

为了最大限度地降低成本,您可以考虑批处理和优化提示等技术来减少处理的 API 调用和令牌的数量。

延迟和性能

尽管 GPT-4o 提供了令人印象深刻的性能和低延迟,但它仍然是一个大型语言模型,这意味着处理请求可能需要大量计算,从而导致相对较高的延迟。

我们需要优化我们的代码并使用缓存和异步处理等技术来缓解延迟问题。

此外,我们可以探索使用 OpenAI 的专用实例或根据我们的特定用例对模型进行微调,从而提高性能并减少延迟。

用例对齐

GPT-4o 是一个功能强大的通用模型,具有广泛的功能,但我们需要确保我们的具体用例与模型的优势相一致。

在完全依赖 GPT-4o 之前,我们必须仔细评估我们的用例并考虑该模型的功能是否适合我们的需求。

如果有必要,我们可以微调较小的模型或探索可能更适合我们特定任务的其他模型。

结论

GPT-4o 的多模式功能解决了早期模型难以无缝集成和处理不同类型数据的局限性。

通过利用 GPT-4o API,开发人员可以构建无缝集成文本、音频和视觉数据的创新解决方案。

如果你想更多地练习使用 GPT-4o,我推荐这个关于使用 GPT-4o 创建 AI 助手的代码。同样,如果你想了解有关使用 API 的更多信息,我推荐这些资源:

常见问题解答

GPT-4o 是什么?它与之前的型号有何不同?

GPT-4o 是 OpenAI 开发的多模态语言模型,能够处理和生成文本、音频和视觉数据。与 GPT-4 等仅处理文本的先前模型不同,GPT-4o 集成了音频和视觉信息,从而实现了更自然的交互和增强的跨模态能力。

开发人员如何通过 OpenAI API 访问 GPT-4o?

开发人员可以通过注册 OpenAI 账户、获取 API 密钥并安装 OpenAI Python 库来通过 OpenAI API 访问 GPT-4o。

使用 GPT-4o API 的成本是多少,与其他模型相比如何?

GPT-4o API 采用按使用付费模式,费用根据处理的 token 数量计算。与 GPT-4 等之前的型号相比,GPT-4o 的成本降低了 50%,因此更加实惠。本文提供了与其他型号的价格比较。

GPT-4o 可以针对特定用例或行业进行微调吗?

是的,GPT-4o 可以通过迁移学习等技术针对特定用例或行业进行微调。通过对特定领域的数据或任务进行微调,开发人员可以增强模型的性能并根据其独特需求进行定制。

有哪些资源可用于进一步学习和实现 GPT-4o API?

有各种资源可供进一步学习和实施 GPT-4o API,包括教程、课程和实际示例。本文建议探索 DataCamp 的使用 OpenAI API 课程、OpenAI Cookbook 和 DataCamp 的备忘单,以获得快速参考和实际实施指导。

我应该何时使用 GPT-4o 而不是 GPT-4o-mini?

GPT-4o 非常适合需要深入分析、语言理解或更长时间交互的更复杂用例。另一方面,GPT-4o-mini 速度更快、更具成本效益,更适合轻量级任务或需要快速响应的情况。两种模型都提供多模态功能,但当更高级的推理和跨模态交互必不可少时,GPT-4o 更胜一筹。

在具体用例方面,GPT-4o API 与 o1 API 相比如何?

虽然 GPT-4o 非常适合处理涉及多模态数据(文本、音频和图像)的任务,但 o1 API 在复杂的推理和解决问题任务中表现出色,尤其是在科学、编码和数学方面。如果您需要快速响应和适度推理,GPT-4o 是您的最佳选择。但是,对于需要深入逻辑分析和准确性的任务,例如生成复杂的代码或解决高级数学问题,o1 API 提供了更强大的功能。